Filmes

Séries

Programas

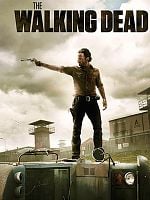

Mais do que um drama de zumbis, The Walking Dead é um drama sobre como as pessoas agem em situações extremas. A série vai mais além do que banhos de sangue, ela traz sede de sobrevivência, esperança, medo, conflitos, dúvidas, escolhas difíceis e situações que nos fazem refletir qual seriam nosas atitudes se estivéssemos no lugar dos sobreviventes, se vivêssemos nesse mundo brutal e sombrio. Os efeitos, a maquiagem, tudo é incrível. The Walking Dead é uma trama envolvente que te coloca num mundo onde o perigo vem dos mortos, dos vivos e do inesperado.